No primeiro semestre do ano de 2018, o Supremo Tribunal Federal anunciou o desenvolvimento de projeto de Inteligência Artificial, em parceria com a Universidade de Brasília – UnB, batizado de VICTOR, em homenagem ao Ministro Victor Nunes Leal (Ministro de 1960/1969). Após esse primeiro anúncio, ao longo do ano de 2018, foram veiculadas várias outras matérias acerca do progresso na construção das redes neurais da ferramenta para rastrear nos processos os temas de repercussão geral, agrupar os processos relacionados entre si pelo tema, além de indicar ao Ministro Presidente da Corte os processos para fins de devolução do recurso à origem ou sua rejeição[1].

Mais de sete anos após esse primeiro sistema de IA, ainda o mais conhecido e usado na organização e agilização dos processos, o Supremo Tribunal Federal já conta com o sistema MARIA (Módulo de Apoio para Redação com Inteligência Artificial), lançado em dezembro de 2024, sendo uma IA generativa para auxiliar na produção de diversos tipos de textos, como resumos de relatórios e a análise inicial de petições, além do VitórIA para automação e integração de processos.

No âmbito do STJ, também diversos sistemas são utilizados, com o mesmo intuito de agilizar tramitação de processos, sobretudo com foco na admissibilidade de Recursos Especiais. Os Principais sistemas são: o ATHOS, sistema de IA baseado em processamento de linguagem natural (PLN), visando a automação da área de triagem e identificação de temas de recursos repetitivos; o STJ LOGOS, mais recente sistema de IA generativa do Tribunal, lançado em fevereiro de 2025, projetado para aumentar a eficiência na produção de decisões, auxiliando na elaboração de minutas, busca de processos semelhantes e análise de admissibilidade de Recursos Especiais; e o SÓCRATES, sistema de IA que também utiliza processamento de linguagem natural no âmbito do Tribunal.

Me atendo tão somente a nomear os sistemas desses dois Tribunais Superiores, é de se notar que os Tribunais dos Estados, Tribunais Regionais Federais, enfim, o Poder Judiciário como um todo, já está em plena era dos algoritmos de inteligência artificial, mas sempre mantendo o discurso de que as ferramentas de IA não serão usadas para tomada das decisões, nem nos julgamentos de mérito dos processos. No entanto, diante do crescimento exponencial das Ciências Cognitivas e da Ciência de Dados – Data Science –, e do enorme impacto da IA[2] no trabalho, sobretudo em ganho de tempo, não há garantias de que, no futuro próximo, as ferramentas de IA não venham a ser usadas nas tomadas de decisões judiciais, como já ocorre em alguns Países, notadamente E.U.A. e Canadá, sobretudo no campo mais sensível do Direito, que diz respeito à liberdade da Pessoa, o da Justiça Criminal.

Para efeito destas breves linhas, iremos inicialmente relatar a experiência dos Estados Unidos com o uso de Inteligência Artificial na Justiça Criminal, a forma de implementação e uso das ferramentas de IA, sua ainda precária validação com pouca clareza em relação aos algoritmos implementados, e os efeitos dramáticos na realidade do uso dessas ferramentas, para então relacioná-la aos discursos de Defesa Social, centrados nas idéias de periculosidade e risco à sociedade, típicos, de um lado, do cientificismo criminológico do século XIX, e de outro, da lógica econômica – custo/benefício – do que se denomina de criminologia atuarial.

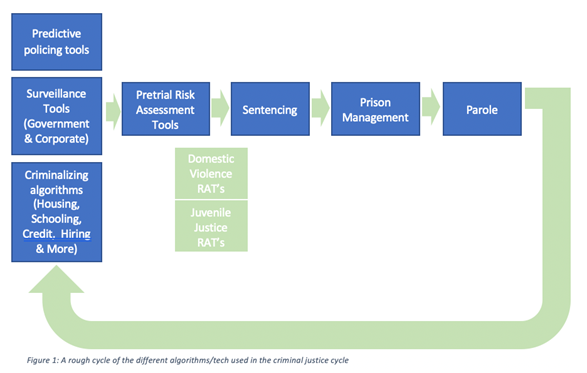

As ferramentas de Inteligência Artificial são usadas, no Sistema Criminal Norte Americano, no que se convencionou chamar de evidence-based practices, ou ainda de risk assessment practices, informando aos julgadores acerca dos potenciais riscos futuros de pessoas submetidas ao Sistema, seja para efeito de dosimetria da pena, fixação de regimes de cumprimento, execução de penas, além de liberdade condicional, prisões provisórias, ou até mesmo para tomada de decisão acerca de pena diversa da prisional.

Assim, submetidos os dados da pessoa a ser avaliada ao(s) programa(s)[3] de IA, que calculará, segundo os algoritmos nele implementados, o risco que tal indivíduo traz à sociedade, os profissionais envolvidos (Juízes, Agentes penitenciários, Agentes de probation, Psicólogos, etc) acessam, em geral por um link ao qual tenham autorização de acesso, o score obtido na avaliação. “Essas ferramentas são baseadas em métodos atuariais de avaliação de riscos e orientam o processo de decisão dos julgadores a partir de análises probabilísticas do potencial de reincidência do acusado, e mesmo de sua periculosidade social (presumidamente aferido por dados da experiência, portanto evidence-based).”[4]

Ou seja, o evidence-based system é um modelo científico, de cálculo matemático, pelos algoritmos implantados, realizado com os dados pessoais do indivíduo examinado, com vistas à liberdade condicional, suspensão do processo, possibilidade de pena restritiva de direito, mas também sobre prisão provisória, duração da pena prisional, regime de cumprimento de pena prisional, submissão à “tratamentos” psiquiátricos, dentre outras medidas de controle penal.

O uso das ferramentas de IA teve como justificativa a situação caótica, além de muito custosa para o Estado, do processo de encarceramento em massa nos E.U.A., incrementado com a política de “guerra às drogas”, a partir dos anos 70, voltada sobretudo para o controle penal da juventude negra e pobre dos E.U.A.[5], também tendo como incremento o grande número de reincidências, aumentando as estatísticas acerca da criminalidade. Desta forma, como parte de um esforço para reduzir o alto nível de reincidência e melhorar os índices de segurança pública, com o viés na Defesa Social, mas sobretudo com o intuito de diminuir os gastos públicos com o sistema criminal, as políticas criminais voltaram-se para o uso dos programas de Inteligência Artificial[6].

A ideia do sistema de justiça criminal se valer das ferramentas de IA tinham por escopo desafogar o sistema prisional, reservando a segregação, até mesmo por um tempo maior do que o proporcional ao delito cometido, aos acusados e condenados considerados mais “perigosos”, enquanto outros poderiam ter penas menores, ou mesmo penas alternativas à prisão, uma vez que seus scores apontassem para um baixo risco.

Se o objetivo da aplicação das ferramentas era, a princípio, de uma maior eficácia na política de descarcerização, consequentemente, na diminuição dos custos do sistema prisional e de toda Justiça Criminal, na prática, seu uso só aprofundou a discriminação e a seletividade do sistema, transformando-se em instrumento que afasta o devido processo legal e a possibilidade de um julgamento justo; o que ensejou legítimas preocupações sobre a confiabilidade e (im)parcialidade dessas ferramentas.

“This century’s automated decision making systems combine individual adjudications with rulemaking while adhering to the procedural safeguards of neither. Automated systems jeopardize due process norms. Hearings are devalued by the lack of meaningful notice and by the hearing officer’s tendency to presume a computer system’s infallibility. The Mathews v. Eldridge cost-benefit analysis is ill-equipped to compare the high fixed cost of deciphering a computer system’s logic with the accumulating variable benefit of correcting myriad inaccurate decisions made based on this logic.”[7]

No campo da Justiça Criminal, a ideia de infalibilidade dos softwares de risk assessments tem recebido diversas e duras críticas, uma vez que em relação às pessoas, com toda sua subjetividade, capacidade de transformação ao longo da vida, experiências concretas, é impossível a obtenção de avaliação de risco pessoal com base no histórico passado. Apenas a título de exemplo: o cometimento de um delito na adolescência, em tese, não diz nada a respeito da pessoa que aos quarenta anos se envolva em outro delito; mas as ferramentas de IA são construídas para computar negativamente a conduta juvenil, desconsiderando o tempo que a pessoa viveu sem qualquer envolvimento criminal.

As ferramentas – risk assessment tools – “pontuam” o suspeito e/ou acusado entre sendo de low risk até a maior pontuação de high risk, não pelo fato concreto delituoso que eventualmente tenha cometido, ou seja suspeita de cometer, mas sim sobre sua personalidade, meio social em que foi criado, ou em que vive no momento, vizinhança, amizades, enfim, todos os elementos que absolutamente não são “neutros” ou “objetivos”, como pretendem os defensores do uso das ferramentas de risk assessment.[8]

Algumas ferramentas ainda apresentam problemas em relação ao que se denomina N-Tuple Counting[9], nos casos em que um suposto mesmo fato criminoso pode ser computado por ferramentas como vários. Por exemplo, se a pessoa foi conduzida à delegacia por determinada conduta, depois ficou presa preventivamente e ao final denunciada e processada por este fato, a ferramenta LSR-I[10], ver listagem abaixo, conta o mesmo fato, que teve 3 desdobramentos (polícia/prisão preventiva/processo) como 3 eventos separados, triplicando o score em direção a uma avaliação high risk.

“Another reason for the n- tuple effect arises within the risk Technologies them selves. Many risk instruments assign points more than once for a single prior event, particulary those maintain numerous and overlapping criminal offending items in their scoringsheets”

Melissa Hamilton, em seu artigo de 2014, lista as ferramentas de risk assessment usadas nos E.U.A., tanto pelas Justiças dos Estados quanto na Justiça Federal, informando-nos que várias gerações de ferramentas foram desenvolvidas ao longo das últimas décadas. Atualmente, já estariam em uso ferramentas de quarta geração, o que não significa que ferramentas anteriores não sejam mais usadas. Seguem abaixo listadas algumas ferramentas de Inteligência artificial e quais os fatores elas levam em conta para calcular os riscos.

| 2. Third Generation Tools | |

| INSTRUMENT | FACTOS RATED |

| HCR-20 | Historical Previous violence Prior supervision failure Young age at first violent incident Relationship instability Employment problems Substance use problems Major mental illness Psychopathy Personality disorder Clinical Lack of insight Negative attitudes Active symptoms of major mental illness Impulsivity Treatment nonresponsive Risk Management Plans lack feasibility Exposure to destabilizers Lack of personal support Noncompliance with remediation Stress |

| LSI-R | Criminal History Prior adult convictions Number of current offenses Arrested before age 16 Prior incarceration Escape history Punished for institutional misconduct Community supervision violation History of violence Education/Employment Employment history Educational attainment School suspensions Participation in school activities Peer interactions Interactions with authorities Financial Financial problems Reliance on social assistance Family/Marital Dissatisfaction with marital situation Interaction with parents Criminal family Accommodations Residential stability High crime neighborhood Leisure/Recreation Participation in organized activity Appropriate use of time Companions Socially isolated Criminal acquaintances Alcohol/Drugs Alcohol problems Drug problems Alcohol/drugs contributed to law violations Family alcohol/drug use Emotional/PersonalDistress Psychosis Mental health treatment Prior psychological assessment Attitudes/Orientation Procriminal attitudes Prosocial orientation Attitude toward sentence Attitude toward supervision |

3. Fourth Generation Tools

| INSTRUMENT | FACTORS RATED |

| Federal Post Conviction Risk Assessment (PCRA) | Number of prior arrests Prior community supervision violations Institutional adjustment problems History or current violent offense Varied offending pattern Age Married Highest education level Employment status Work history Alcohol problems Drug problems Family problems Lack of social support Motivated to change |

| COMPAS | Criminal involvement History of noncompliance History of violence Current violence Criminal associates Substance abuse Financial problems Vocational or educational Family criminality Social environment Leisure Residential instability Social isolation Criminal atitudes Criminal personality |

A tabela[11] acima reproduzida demonstra claramente que os fatores avaliados, e pontuados, sobre os quais os diferentes programas de Inteligência Artificial fazem seus cálculos atuariais de probabilidade de reincidência, ou seja de que aquela pessoa venha a praticar eventual futuro hipotético crime, são feitos sobre acontecimentos passados, como descumprimento de condições na liberdade assistida, ou ainda detenções anteriores (pode ser desde uma mera condução à Polícia, sem maiores consequências até uma prisão provisória), mas também sobre aspectos subjetivos da pessoa, tais como “personalidade distorcida” (personality disorder), “personalidade criminosa (criminal personality) ou ainda “isolamento social” (social isolation), e de cunho privado, como se o individuo é solteiro ou casado (marital status / lived with intimate partner for 2 years), casa própria (own residence / residential estability).

Ou seja, a ferramenta de risk assessment pode até ser científica, ou “neutra”, como pretendem alguns, mas a base de dados sobre a qual vai trabalhar não o é, pois a realidade da Justiça Criminal é a da seletividade. De outro lado, a pontuação que corresponde a cada item, determinada por dados empíricos, acaba também por incorporar o viés seletivo do próprio sistema, eis que pontua negativamente, levando a pessoa a apresentar um high risk, o fato de pertencer a grupos sociais mais criminalizados, ou criminalizáveis, como negros, jovens e pobres.

A ProPublica, agência não governamental de Jornalismo voltado para o interesse público, realizou pesquisa[12] sobre as ferramentas de risk assessment, após relatos de inúmeros casos de erros, e vieses discriminatórios nas pontuações individuais, nas avaliações das ferramentas.

“Alguns dados sobre a utilização do COMPAS na Florida também trazem preocupação. Citam-se algumas conclusões de pesquisadores da ProPublica, que analisou 10.000 condenações em Broward County: (i) acusados negros frequentemente foram classificados com maior risco de reincidência do que efetivamente possuíam. Acusados negros que não reincidiram em um período de dois anos tinham o dobro de chance de serem erroneamente classificados como alto risco de reincidência, em relação aos acusados brancos (45% contra 23%); (ii) acusados brancos frequentemente foram classificados com menor risco do que efetivamente possuíam. Acusados brancos que reincidiram em um intervalo de dois anos foram equivocadamente classificados como baixo risco reincidência em uma proporção quase duas vezes maior que os acusados negros (48% contra 28%); (iii) no tocante à reincidência especificamente para crimes violentos, acusados negros foram erroneamente classificados como alto risco em uma taxa duas vezes maior que acusados brancos.”[13]

A EPIC – Electronic Privacy Information Center publicou[14] dados acerca do uso de algoritmos no sistema de Justiça Criminal Norte Americana – Algorithms in the Criminal Justice System -, no qual traz sérias dúvidas acerca da uso das ferramentas de Inteligência artificial na Justiça Criminal, em razão da opacidade dos algoritmos usados, sendo que os programas não são publicizados, além de não contarem, a maior parte deles, com estudos de validade, portanto confiabilidade das ferramentas, dos programas usados.

“Criminal justice algorithms—sometimes called “risk assessments” or “evidenced-based methods”—are controversial tools that purport to predict future behavior by defendants and incarcerated persons. These proprietary techniques are used to set bail, determine sentences, and even contribute to determinations about guilt or innocence. Yet the inner workings of these tools are largely hidden from public view.

Many “risk assessment” algorithms take into account personal characteristics like age, sex, geography, family background, and employment status. As a result, two people accused of the same crime may receive sharply different bail or sentencing outcomes based on inputs that are beyond their control—but have no way of assessing or challenging the results.

As criminal justice algorithms have come into greater use at the federal and state levels, they have also come under greater scrutiny. Many criminal justice experts have denounced “risk assessment” tools as opaque, unreliable, and unconstitutional. The Supreme Court is also considering whether to take a case onthe use of a secretive technique to predict possible recidivism.”[15]

E mais, a análise da EPIC também demonstra o quanto as diferentes ferramentas de que se vale o Sistema Criminal apresentam problemas também em relação à própria forma de cálculo, portanto dos algoritmos inseridos na ferramenta, do risco da pessoa submetida à avaliação.

A ideia do uso de ferramentas que pudessem prever os riscos de reincidência do indivíduo, e assim, ele ficaria mais tempo na cadeia do que a proporcionalidade do fato concreto recomenda – o que por si só já é uma grave violação a Direito individuais, tinha como discurso o de reservar o encarceramento apenas para os mais perigosos, no entanto, a seletividade típica do sistema criminal (raça, gênero, pobreza) se “infiltrou” na matemática dos instrumentos, fazendo-nos refletir acerca da necessidade de uma maior controle sobre as ferramentas de IA, do ponto de vista científico, mas também do ponto de vista ético e de respeito ao Direitos e Garantias Fundamentais, sob pena de reproduzirmos exatamente o que se pretende combater.

Documento do Institute of electrical and electronics Engineer (IEEE)[16] sobre ética no desenho dos sistemas autônomos de Inteligência Artificial pugna pela necessidade de alguns princípios nortearem as ferramentas:

“- Princípio dos Direitos Humanos: Como garantir que os sistemas de IA não infrigem os direitos humanos? Ou seja, como deverão os sistemas computacionais ser desenhados de forma a respeitar a igualdade de direitos nos humanos? Por exemplo, quando os nossos sistemas são treinados com dados que, à partida, reflectem uma sociedade estratificada e desigual, não estaremos a perpetuar estas desigualdades reforçando ainda mais o que negativo existe?

– Princípio da Responsabilidade: Como garantir que os sistemas de IA são “responsáveis”? Quando os sistemas são autónomos e executam acções de forma independente, sem o controlo humano, de quem é a responsabilidade da execução da acção? Como garantir a moralidade das acções executadas?

– Princípio da Transparência: Como garantir que as decisões efectuadas pelas máquinas sejam transparentes para os humanos? Isto é, como garantir que seja possível descobrir a razão de uma dada acção, decisão ou escolha feita pelo sistema de IA? Quando as decisões são efectuadas por algoritmos complexos e baseados em dados, esta transparência pode não ser trivial. Por exemplo, um sistema autônomo pode decidir se uma pessoa deve ter crédito ou não com base no perfil da pessoa e nos dados. No entanto, não existe um conjunto de regras que dite a decisão.

– Princípio da Educação e Consciência Pública: Como educar os cidadãos de forma a estarem cientes dos riscos da má utilização de sistemas IA?”[17]

Se, de um lado, é impossível negar o avanço digital, sendo até mesmo uma atitude ingênua ignorar os novos desafios que tecnologias 4.0 impõem; de outro lado, necessitamos de análise profunda, com olhar crítico, das ferramentas que se apresentam a nós como salvadoras, seja do orçamento, seja dos problemas de segurança pública. Decisões prontas, sobretudo as que reproduzem a desigualdade e seletividade do sistema penal não interessa à sociedade.

A Electronic Privacy Information Center (EPIC) através da Public Voice publicou o que intitularam de uma Universal Guideline for artificial Intelligence:

“We propose these Universal Guidelines to inform and improve the design and use of AI. The Guidelines are intended to maximize the benefits of AI, to minimize the risk, and to ensure the protection of human rights. These Guidelines should be incorporated into ethical standards, adopted in national law and international agreements, and built into the design of systems. We state clearly that the primary responsibility for AI systems must reside with those institutions that fund, develop, and deploy these systems.

- Right to Transparency. All individuals have the right to know the basis of an AI decision that concerns them. This includes access to the factors, the logic, and techniques that produced the outcome.

- Right to Human Determination. All individuals have the right to a final determination made by a person.

- Identification Obligation. The institution responsible for an AI system must be made known to the public.

- Fairness Obligation. Institutions must ensure that AI systems do not reflect unfair bias or make impermissible discriminatory decisions.

- Assessment and Accountability Obligation. An AI system should be deployed only after an adequate evaluation of its purpose and objectives, its benefits, as well as its risks. Institutions must be responsible for decisions made by an AI system.

- Accuracy, Reliability, and Validity Obligations. Institutions must ensure the accuracy, reliability, and validity of decisions.

- Data Quality Obligation. Institutions must establish data provenance, and assure quality and relevance for the data input into algorithms.

- Public Safety Obligation. Institutions must assess the public safety risks that arise from the deployment of AI systems that direct or control physical devices, and implement safety controls.

- Cybersecurity Obligation. Institutions must secure AI systems against cybersecurity threats.

- Prohibition on Secret Profiling. No institution shall establish or maintain a secret profiling system.

- Prohibition on Unitary Scoring. No national government shall establish or maintain a general-purpose score on its citizens or residents.

- Termination Obligation. An institution that has established an AI system has an affirmative obligation to terminate the system if human control of the system is no longer possible.”[18]

No contexto da Justiça Criminal, é preciso reter pelo menos cinco delas, quais sejam a preocupação com processos e julgamentos justos e transparentes, a existência da autonomia e autodeterminação humana, a necessidade de estabelecer controles para maior precisão dos dados e da qualidade destes, a segurança e confiabilidade dos dados, e reduzir ao máximo seus objetos de aplicação, eis que julgar pessoas, por fatos, e não pela pessoa que é, foi ou será (impossível até mesmo na ficção) na seara criminal.

O maior interesse em estudarmos as experiências já implantadas em outros países, sobretudo em tempos nos quais a tendência no Brasil é copiar, de forma a-crítica, instrumentos e institutos importados, sobretudo dos Estados Unidos, sem que tenhamos identidade de ordenamentos jurídicos (Common Law x Civil Law), é justamente de podermos aprender a lição construindo ferramentas que eliminem os vieses discriminatórios de nossa realidade social racista, patriarcal e patrimonialista. “O futuro chegou; a inteligência artificial está aí. Quem ficar parado não saberá de onde vem o tiro decisório.”[19]

Para tanto, precisamos desenhar as ferramentas matemáticas dialogando criticamente sobre os seus critérios, possíveis consequências de seu uso, e mantermos o foco no Ser Humano. Precisamos desenhar sistemas de Inteligência Artificial que possam enquadrar-se eticamente no fundamento maior que é o princípio da Dignidade Humana.

BIBLIOGRAFIA

CITRON, Danielle Keats. Technological Due Process. Washington University Law Revue, Vol. 85, Issue 6, 2008, disponível em https://openscholarship.wustl.edu/cgi/viewcontent.cgi?referer=&httpsredir=1&article=1166&context=law_lawreview

HAMILTON, Melissa. Back to the Future : The Influence of Criminal History on Risk Assessments. Berkeley Journal of Criminal Law 75, University of Houston Law Center No. 2015-A-1, 2015, revisado em 2018, disponível em https://papers.ssrn.com/sol3/papers.cfm?abstract_id=2555878

————————–. Risk-Needs Assessment: Constitutional and Ethical Challenges. American Criminal Law Review 231, University of Houston Law Center No. 2014-W-2, 2015, disponível em https://papers.ssrn.com/sol3/papers.cfm?abstract_id=2506397

QUIRÓS, Diego Zysman. Castigo e Determinação da pena no E.U.A. – Um estudo sobre as United States Sentencing Guidelines. Trad. Jacson Zilio, Florianópolis, Empório do Direito, 2017.

ROSA, Alexandre Moraes da. Desejo made in Machine: o Fascínio da Inteligência Artificial. https://www.conjur.com.br/2018-nov-16/limite-penal-desejo-made-in-machine-fascinio-inteligencia-artificial

STARR, Sonja B.. Evidence-Based Sentencing and the Scientific Rationalization of Discrimination. Law and Economics Research Paper Series, Paper 13-014, University of Michigan Law School, 2013, disponível em https://papers.ssrn.com/sol3/papers.cfm?abstract_id=2318940

TOVO, Antônio. O Periculosômetro Digital, disponível em https://www.ab2l.org.br/o-periculosometro-digital/

TRANCOSO, Isabel, PAIVA, Ana. “Inteligência Artificial” in NEVES Maria do Céu P, CARVALHO, Maria da Graça (coord.). Ética Aplicada. Novas Tecnologias. Lisboa, Ed. Almedina, 2018.

VILLANI, Cédric e outros. Donner um Sens à l´Intelligence Artificielle – Pour une Stratégie Nationale et Européenne. Relatório oficial, março 2018, disponível em https://www.ladocumentationfrancaise.fr/rapports-publics/184000159/index.shtml ou https://www.aiforhumanity.fr/pdfs/9782111457089_Rapport_Villani_accessible.pdf

RELATÓRIOS E ESTUDOS

EPIC – Electronic Privacy Information Center, Algorithms in the Criminal Justice System, disponível https://epic.org/algorithmic-transparency/crim-justice/

ProPublica, Machine Bias – There´s Software Used across the Country to Predict Future Criminals. And it´s Biased Against Black. Disponível em https://www.propublica.org/article/machine-bias-risk-assessments-in-criminal-sentencing

[1] neste sentido ver http://www.altosestudos.com.br/?p=57714 ,

[2] Neste sentido ver TRANCOSO, Isabel, PAIVA, Ana. “Inteligência Artificial” in NEVES Maria do Céu P, CARVALHO, Maria da Graça (coord.). Ética Aplicada. Novas Tecnologias. Lisboa, Ed. Almedina 2018, pp.169/185.

[3][3] Existem várias ferramentas, algumas de propriedade intelectual privada, outras desenvolvidas por agências estatais, por exemplo, COMPAS (Propriedade intelectual NorthPoint inc.), LSI-R (empresa MHS Assessments), ou ainda PTRA (Federal Pretrial Risk Assessment), sendo que atualmente são mais usadas ferramentas de 3.o. e 4.o. gerações nos E.U.A e Canadá, dependendo dos estados. Neste sentido, ver https:// https://epic.org/issues/ai/ai-in-the-criminal-justice-system/

[4] TOVO, Antônio. O Periculosômetro Digital, janeiro 2019,disponível em https://www.ab2l.org.br/o-periculosometro-digital/

[5] Qualquer semelhança com o encarceramento em massa no Brasil não é mera coincidência.

[6] Neste sentido ver TOVO, Antônio. Artigo citado acima. “A expressiva cifra inclui os custos de construção e manutenção de presídios, de criação de uma rede de atendimento de saúde para os condenados, pagamento de agentes penitenciários e de livramento condicional e de todos os servidores envolvidos com a administração das engrenagens da máquina punitiva. A análise do DOJ cotejou o peso orçamentário do sistema penal com os resultados obtidos. A conclusão foi bastante singela: o aumento da despesa não significou diminuição de criminalidade nem da taxa de reincidência dos condenados. Como uma das modalidades de reorientação de tal política, surge o recurso aos algoritmos atuariais na Justiça Criminal como forma de arrefecer o hiper-encarceramento.”

[7] CITRON, Danielle Keats. Technological Due Process. Washington University Law Revue, Vol. 85, ver https://openscholarship.wustl.edu/cgi/viewcontent.cgi?referer=&httpsredir=1&article=1166&context=law_lawreview

[8] Figura demonstrando como pontuam os algoritmos consulta em https://epic.org/issues/ai/ai-in-the-criminal-justice-system/

[9] HAMILTON, Melissa.Back to the Future : The Influence of Criminal History on Risk Assessment. . Berkeley Journal of Criminal Law 75, University of Houston Law Center No. 2015-A-1, 2015, revisado em 2018, pp. 97/100, disponível em https://papers.ssrn.com/sol3/papers.cfm?abstract_id=2555878

13 Ainda neste tema, Melissa Hamilton : “The California Static Risk Assessment is na automated actuarial tool using rap sheets that is entirely based on a weighted counting of 18 criminal history factors, many of which overlap”. HAMILTON, Melissa. Risk-Needs Assessment: Constitutional and Ethical Challenges. American Criminal Law Review 231, University of Houston Law Center No. 2014-W-2, 2015, disponível em https://papers.ssrn.com/sol3/papers.cfm?abstract_id=2506397

[11] Idem, Appendix A: Popular Risk Assessment Tools, pp. 286/291.

[12] ProPublica, Machine Bias – There´s Software Used across the Country to Predict Future Criminals. And it´s Biased Against Black. Disponível em https://www.propublica.org/article/machine-bias-risk-assessments-in-criminal-sentencing

[13] TOVO, Antônio. O Periculosômetro Digital, janeiro 2019,disponível em https://www.ab2l.org.br/o-periculosometro-digital/

[14] Algorithms in the Criminal Justice System https://epic.org/algorithmic-transparency/crim-justice/

[15] Ibidem.

[16] IEEE – Institute os Electrical and Electronics Engineer se apresenta como « the world´s largest technical professionalorganization dedicated to advancing technology for benefit of humanity ». https://www.ieee.org/

[17] TRANCOSO, Isabel, PAIVA, Ana. 2018, Op. Cit. Pp. 172/173

[18] https://thepublicvoice.org/ai-universal-guidelines/

[19] ROSA, Alexandre Moraes da. Desejo made in Machine: o Fascínio da Inteligência Artificial. https://www.conjur.com.br/2018-nov-16/limite-penal-desejo-made-in-machine-fascinio-inteligencia-artificial